글쓴이 보관물: bigrootno1@gmail.com

효율적인 이벤트 분석

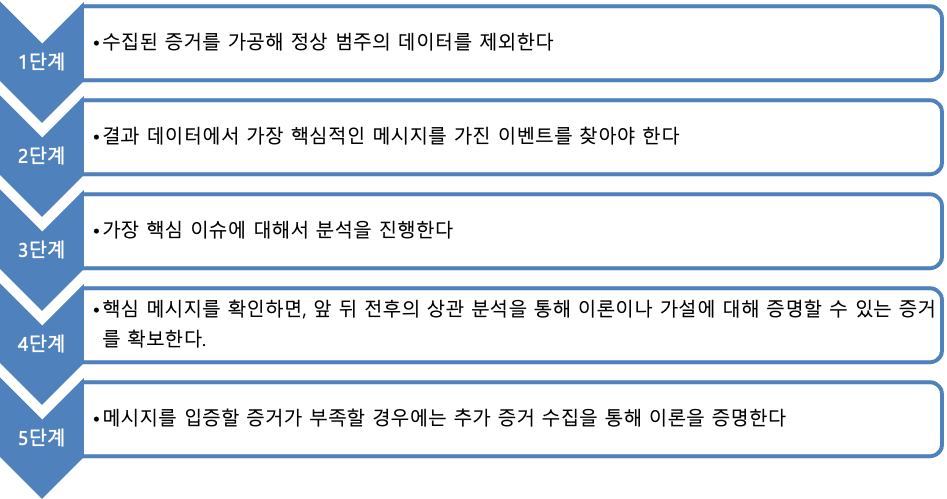

효율적으로 이벤트를 분석하기 위해 다음과 같은 단계를 거치게 된다.

가장 먼저 수행하는 작업이 분석 정보를 선별하는 것이다. 네트워크 패킷이나 로그를 보기 좋게 가공하는 과정이다. 보기 좋게 가공한다는 것은 먼저 수집된 정보 중 정상 범주의 데이터를 제외 하는 과정이다. 이 부분이 이번 장에서 첫 번째로 배우게 될 짚더미 치우기다.

정상 범위의 데이터를 제외하고 나며 선별된 정보에서 가장 핵심적인 메시지를 찾아 낸다. 이 핵심 이벤트를 찾는 것이 여러분이 두번째로 배우게 될 공격 구분 이다. 그리고 핵심 메시지를 찾아 냈다면 시스템에 미치는 영향을 통해 이론이나 가설을 증명 하게 된다. 만약 적정한 정보를 찾지 못하거나 잘못된 데이터 가공이 이뤄졌다면 추가 증거 수집을 통해 분석 과정을 반복한다.

- 무조건 많은 정보를 수집하는 것이 증거 수집은 아니다.

- 분석되지 않은 데이터나 사용되지 않는 데이터는 의미가 없다.

- 분석을 통해 즉각적인 행동과 정보 보호 전략을 수립한다.

- 기본적인 데이터는 자동으로 처리하여 효율적으로 분석한다.

- 보안 위협에 대응하는 보안팀의 대응 마인드도 중요하다.

웹로그분석(짚더미치우기)

짚더미를 치운다는 것은 분석되지 않거나 불필요한 정보를 치워서 좀더 효율적으로 이벤트를 분석하기 위한 작업 이다. 가능한 부분은 프로그램이나 오픈 소스를 이용해 자동으로 분류해서 분석 대상을 선별하는 것도 방법 중 하나다.

다음과 같은 가정을 해보자.

“일반적인 네트워크 트래픽엔 공격 패킷이나, 악성코드가 없다.”

하지만 이러한 착한 트래픽은 모래 더미처럼 수 없이 많다. 모래 더미에 숨어 있는 바늘 같은 공격 트래픽을 찾는 일은 결코 쉬운 일이 아니다.

모래더미처럼 쌓아 놓은 정보들 중에 불필요한 정보들을 치워 보자.

웹 로그를 이용해 짚더미를 치우는 방법은 같이 살펴보자. 로그 파서를 설치하고 실행 시키면 로그를 분석하기 위해서는 로그 타입을 “ IISW3CLOG” 형식으로 지정 한다.

<짚더미 1단계 – 메소드 점검>

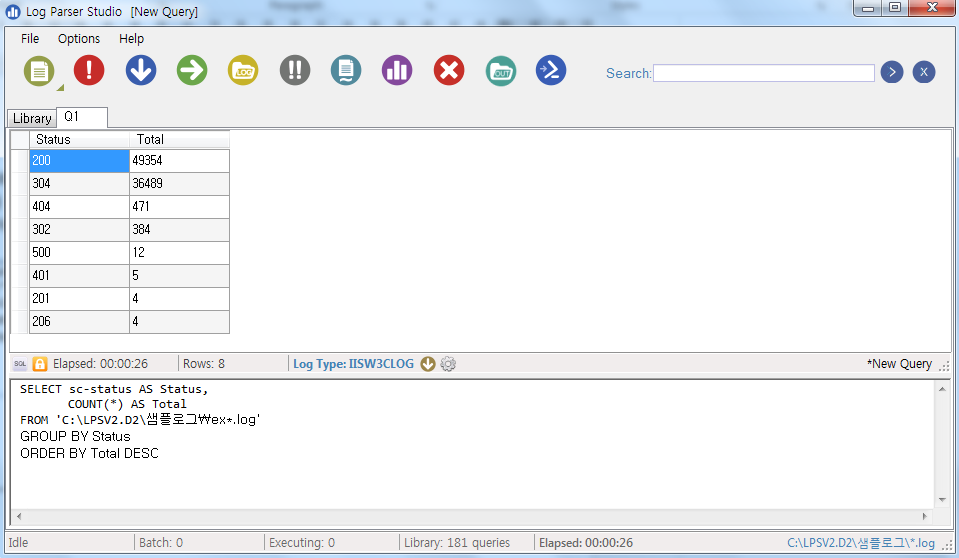

먼저 분석할 웹 로그에서 응답 코드 현황에 대한 통계를 추출한다.

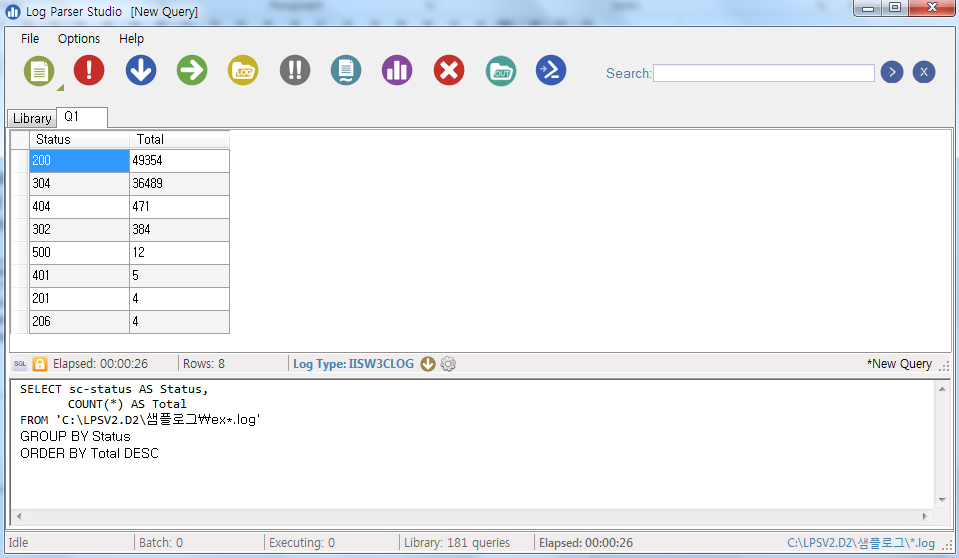

먼저 샘플 로그를 저장하고 해당 로그 위치를 경로로 지정해 다음과 같은 쿼리 문은 로그 파서 쿼리창에 입력하고 실행 버튼()을 클릭 하면 다음 그림처럼 응답코드 통계를 추출할 수 있다.

| SELECT sc-status AS Status, COUNT(*) AS Total FROM ‘C:\LPSV2.D2\샘플로그\ex*.log’ GROUP BY Status ORDER BY Total DESC |

<짚더미 치우기 2단계 – 정상으로 보이는 짚더미를 치운다>

일반적으로 웹 응답과정에서 자주 발생하는(흔히 정상 범주에 해당하는) 응답코드를 제외하고 나머지 코드를 살펴 보자. 정상 범주에 대한 기준은 다음과 같이 정의 하자.

| 응답코드 | 설명 |

| 200 | 클라이언트 요청이 성공했습니다. |

| 302 | 개체 이동 |

| 304 | 수정되지 않았습니다. |

| 404 | 찾을 수 없습니다. |

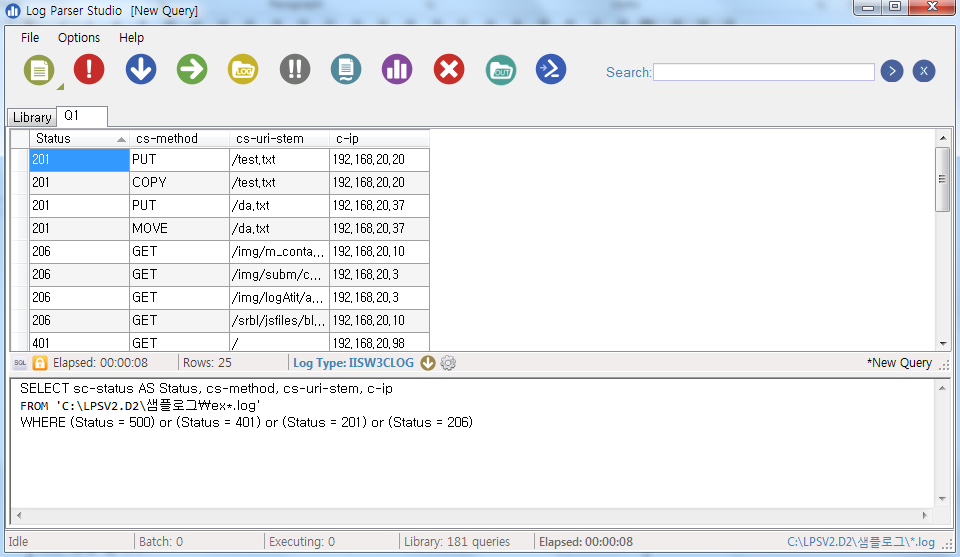

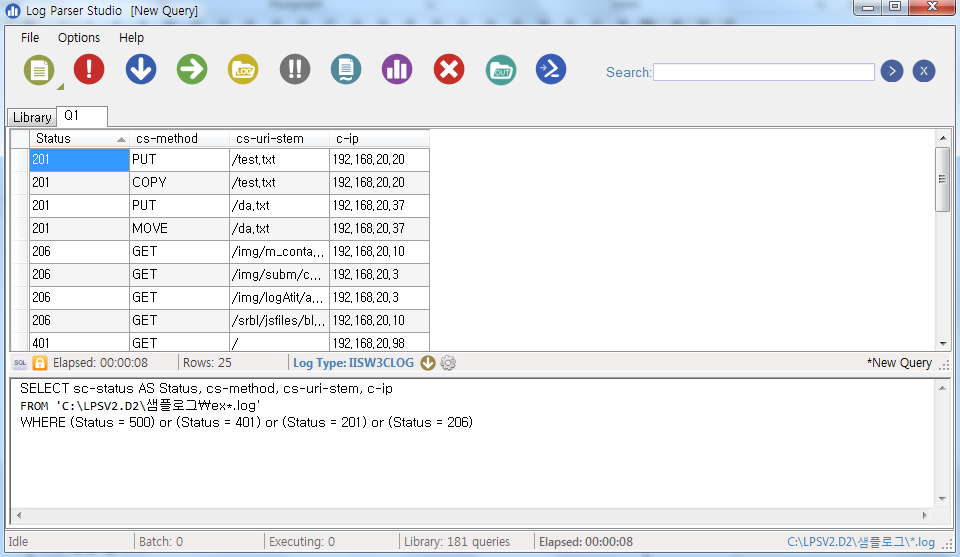

4개 응답코드를 제외하고 500(에러), 401(거부), 201(파일생성), 206(일부응답)와 같이 잘 발생하지 않는 응답코드 위주로 분석을 진행 하자. 동일하게 로그 파서 쿼리 창에 다음과 같이 입력하고 실행 한다.

| SELSELECT sc-status AS Status, cs-method, cs-uri-stem, c-ip FROM ‘C:\LPSV2.D2\샘플로그\ex*.log’ WHERE (Status = 500) or (Status = 401) or (Status = 201) or (Status = 206) |

총 25개의 결과물이 검색되었다. 25개 정도면 충분히 하나씩 전수 분석이 가능한 범위다. 응답코드를 정렬해서 하나씩 살펴보자.

먼저 201 응답 코드로 응답된 URL을 보면 /test.txt, /da.txt URL에 대해 3가지 메소드(PUT, COPY, MOVE)가 사용되었다.

| Status | cs-method | cs-uri-stem | c-ip |

| 201 | PUT | /test.txt | 192.168.20.20 |

| 201 | COPY | /test.txt | 192.168.20.20 |

| 201 | PUT | /da.txt | 192.168.20.37 |

| 201 | MOVE | /da.txt | 192.168.20.37 |

<짚더미 치우기 3단계 – 공격자 상세 분석>

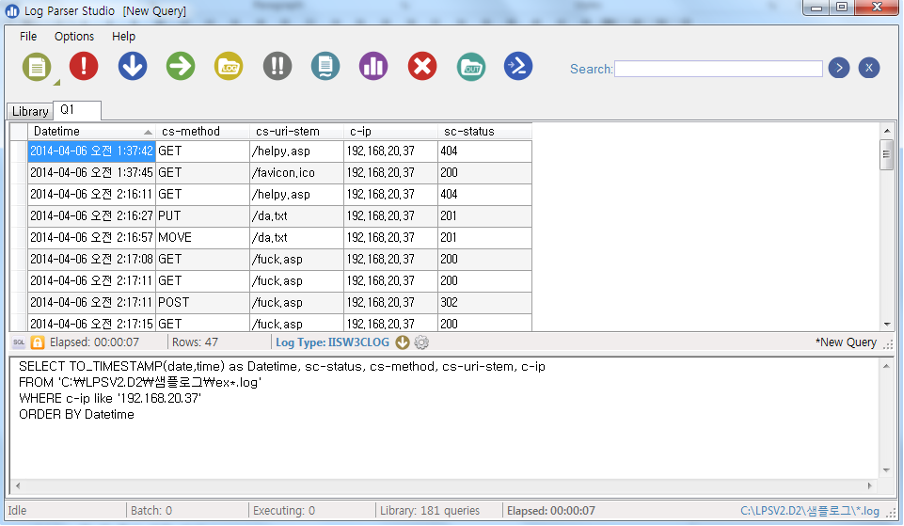

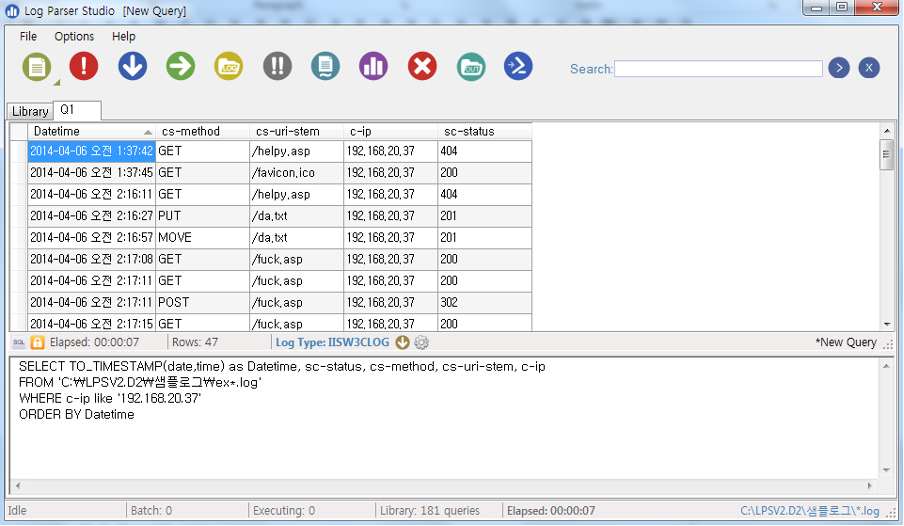

이제 공격자로 의심되는 IP에 대해 상세하게 분석해 보자.

다음 그림 처럼 쿼리문을 입력하고 결과를 확인해 보자.

| SSELECT TO_TIMESTAMP(date,time) as Datetime, sc-status, cs-method, cs-uri-stem, c-ip FROM ‘C:\LPSV2.D2\샘플로그\ex*.log’ WHERE c-ip like ‘192.168.20.37’ ORDER BY Datetime |

웹 로그를 분석해 보면 192.168.20.37 IP에서 PUT메소드를 이용해 da.txt파일을 업로드 하였고, 성공적으로(201 응답코드) 웹 서버에 파일이 업로드 된것을 알 수 있다. 이후 공격자는 MOVE메소드를 이용해서 업로드한 da.txt 파일을 fuck.asp 파일로 변경하였다.

해당 파일은 IIS 환경에서 동작하는 웹 쉘 파일로 공격자는 웹쉘을 이용해 웹 서버를 장악했다.

정상 범주의 데이터를 제거한 것만으로 공격자의 공격 경로를 찾아 낸 것이다.

패킷 분석

앞서 로그를 이용해 침해 분석하는 방법을 살펴 보았다. 이번에는 네트워크 패킷을 분석해 보자. 마찬가지로 분석 범위를 선정하는 작업 만으로도 상당히 침해분석을 효율적으로 수행 할 수 있다.

<짚더미 1단계 – 메소드 점검>

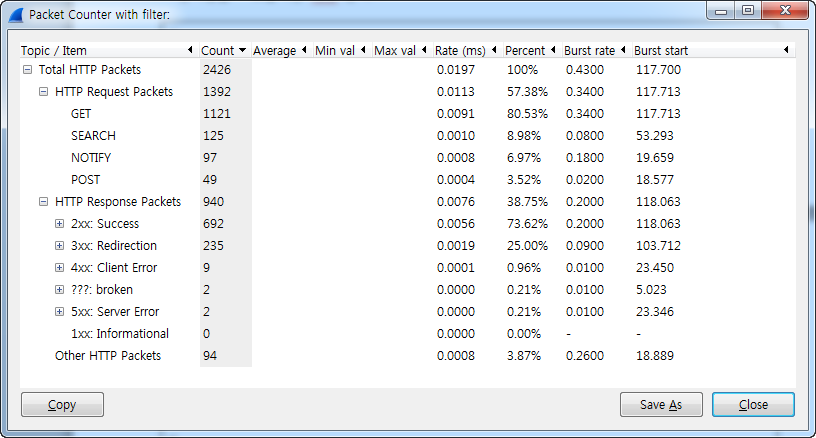

Statistic > HTTP > Packet Counter > 필터 입력 없이 Create stat 클릭

통계 정보를 추출해 보면 사용된 메소드 정보와 웹 서버의 응답 코드 정보를 한눈에 요약해서 살펴 볼 수 있다. 요약된 정보를 통해 분석 대상 범위에서 제외할 정보를 정의한다. 효율적으로 분석 작업을 하기 위해서는 정상 범위의 데이터를 제외할 필요가 있다. 정상 범위를 정의하기 위해 수집한 정보의 현황을 먼저 살펴보는 과정이다.

<짚더미 치우기 2단계 – 정상으로 보이는 짚더미를 치우기>

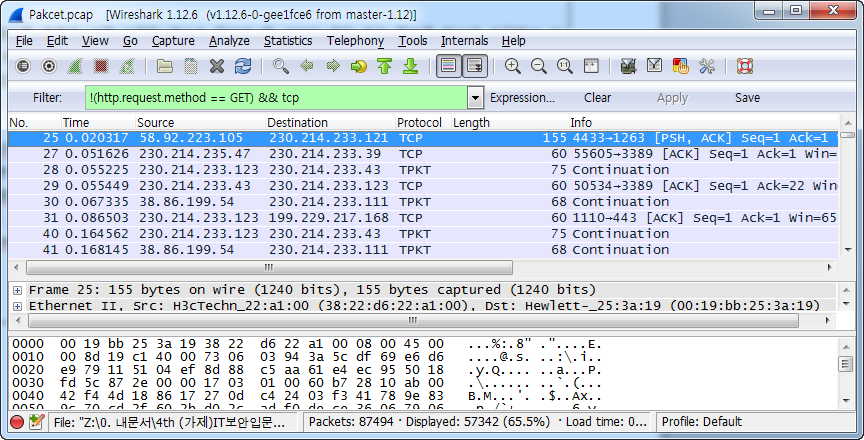

로그 분석할 때와 마찬가지로 정상 범주의 패킷을 제거하자. 정상 범위로 웹 요청 패킷 중 GET 요청 패킷을 제외해보자. 와이어샤크에 패킷 필터 구문을 적용하자.

Filter > BPF(Berkeley Packet Filter) 형식 필터 구문 입력

| !(http.request.method == GET) && tcp |

GET요청이 포함된 패킷을 제외한 TCP 패킷을 불러왔다. 이 과정을 통해서 원본 패킷에서 분석해야 하는 범위를 상당수 좁혔다. 분석 대상을 선택하기 따라 추가적인 범위 구분이 가능 하다.

Case #1 GET요청이 아닌 웹 통신 분석

| !(http.request.method == GET) && tcp.dstport == 80 |

Case #2 실제 데이터 통신이 발생한 패킷만 분석

| !(http.request.method == GET) && tcp.dstport == 80 && tcp[13] == 18 |

Case #3 특정 메소드 분석

| http.request.method == NOTIFY |

<짚더미 치우기 3단계 – 상세 분석>

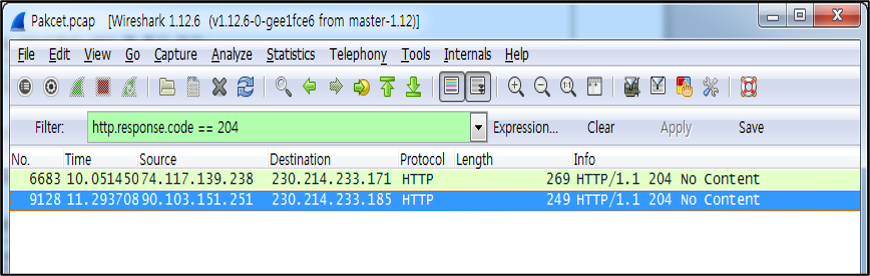

앞서 로그상에 정상 범주를 제외하고 남은 로그에 대해 상세 분석 하듯이 정상 범주를 제외한 패킷 상세 분석을 진행한다. 특정 코드 (“204”)에 의한 패킷분석을 통해서 사고 발생 연관 공격 패킷 또는 피해 관련 증적 정보를 추적한다.

로그와 패킷 분석 작업은 시간과 리소스가 많이 필요한 과정이다. 효율적인 이벤트 분석을 하기 위해 불필요한 데이터를 정제하고 공격의 흔적을 찾이 위해 적정한 범위로 분석 대상을 선별하는 작업이 중요하다.

침해사고 업무절차(워크플로우) 자동화 도구 활용

엔드포인트(Endpoint) 보안에 대한 이해

사이버 보안 침해사고가 발생하면 기업은 내부적으로 침해사고분석을 통해 공격자의 흔적을 찾아내고, 공격 당시 사건을 재구성하여 시스템에 발생한 피해를 파악 한다.

시스템에 침해가 발생하기 까지는 많은 일들이 발생 한다. 공격자가 시스템을 공격하고 장악하기 위해 정보 수집 과정을 거치게 된다. 이 과정에서 공격자는 대상 시스템의 서비스 종류, 시스템 현황, OS종류, IP대역, 포트정보, 취약점 정보 등 많은 정보를 수집하게 된다.

외부의 공격자가 정보 수집을 통해 충분히 공략할 대상 시스템의 약점을 파악했으면 취약점을 이용해 공격에 들어가게 된다. 보통 이 과정에서 많은 수의 공격이 탐지되고 차단이 된다. 공격자는 가능한 모든 방법을 동원해 탐지되지 않기 위해 우회 시도를 하고, 100번의 공격 중 1번의 공격이 성공하게 되면 공격 성공 단계에 이르게 된다. 바로 이 단계가 침해가 발생되는 시점 이다.

시스템 장악에 성공하면 공격자는 자신의 목적에 따라 시스템에 악성코드를 설치하거나 시스템의 정보를 유출하는 행위가 이뤄지고, 많은 경우 침해사고 발생에 대한 인지는 정보 유출 또는 시스템 변조가 발생되고 이뤄지게 된다. 공격자가 공격 대상의 약점을 악용해 개인정보유출과 랜섬웨어로 인한 피해로 이어지게 된다.

보안팀은 공격을 탐지하고 예방하기 위해 다양한 방법을 이용해 침입시도에 대해 모니터 한다. 주로 네트워크에서 발생되는 정보를 활용하게 된다. 가장 많이 사용되는 정보는 침입탐지시스템에서 제공하는 정보를 활용한다. 시스템에 가해지는 공격시도나 공격행위에 대해 네트워크 레벨에서 사전에 분석해 파악하고, 차단하면 시스템 침해를 예방할 수 있다.

시스템에 발생되는 변화를 모두 기록하는 운영체제의 시스템 로그는 보안 사고 대응 관점에서 중요한 정보다. 침해사고가 발생하면 시스템 로그 분석을 통해서 타임테이블을 정의하고 공격 경로와 시스템 피해를 파악할 수 있다. 공격자가 원격에서 시스템에 접근하게 되면 시스템에 접근을 시도한 계정과 원격 IP 또는 접근한 컴퓨터의 정보, 접근 시간 등 사고 조사에 중요한 IOC 정보를 수집할 수 있다.

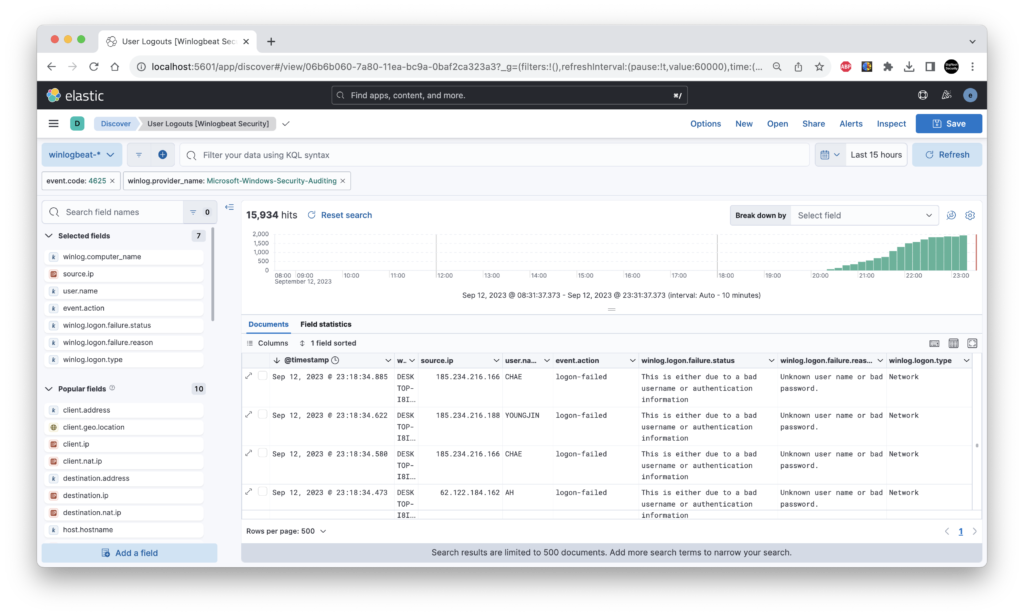

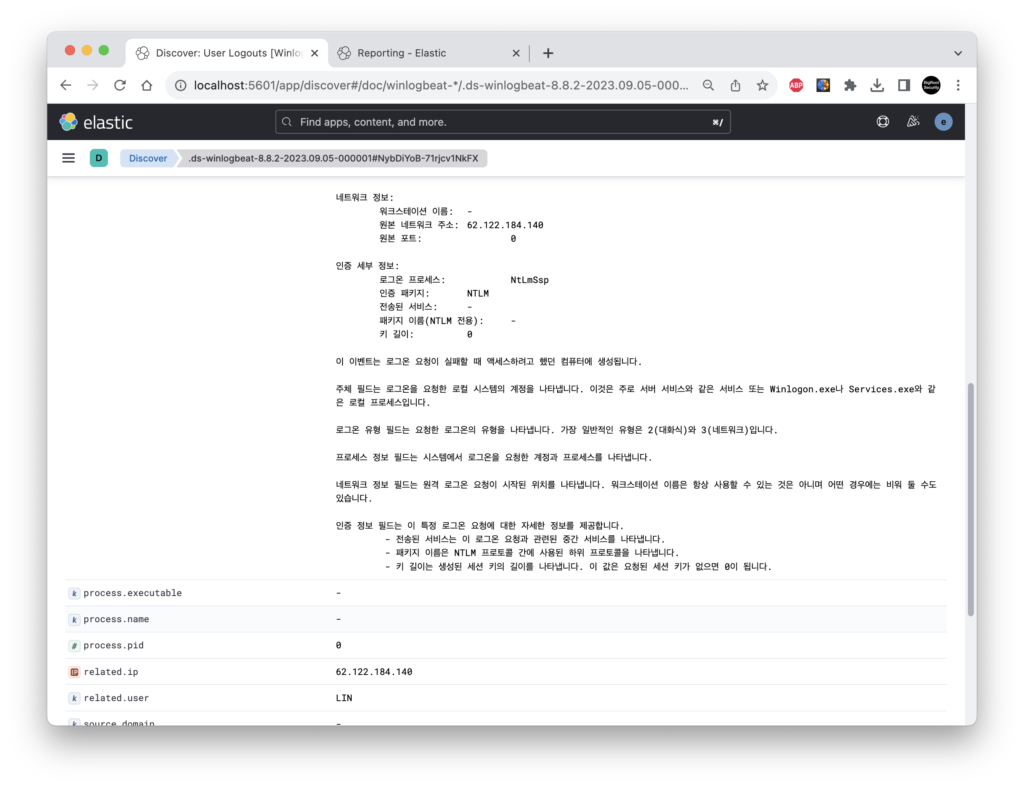

네트워크에 노출된 윈도수 시스템에 로그인을 시도한 로그 샘플을 살펴보자. 해당 로그는 윈도우 보안 이벤트 로그다.

로그를 살펴보면 해외 49개 IP (대부분 러시아)에서 짧은 시간동안 사전식 대입 공격을 통해 로그인을 시도했다. 공격자는 135개의 ‘Username’을 변경해서 네트워크를 통해 로그인을 시도했다. 실제 시스템이 외부에 노출되면 여러분이 예상하는 것보다 빨리 공격에 노출된다. 한가지 흥미로운 부분은 공격자가 로그인을 시도한 Username 이다. 해외 공격자가 로그인을 시도하지만 실제 한글 이름이나 성의 영문 이니셜을 사전 파일로 사용한 것으로 보인다. 공격 대상 국가에 맞춰 사전 파일을 커스터마이징해서 공격하는 모습이 흥미롭다.

공격자의 로그인 실패 로그는 윈도우 보안 이벤트로 남기 때문에 사고 분석이나 보안 모니터링 로그로 활용할 수 있다. 개별 로그의 상세 분석 정보를 통해 필요한 IOC를 추출하고 여러 시스템을 분석할 때 분석 키워드로 사용한다.

운영체제의 시스템 로그는 사고 조사 뿐만 아니라 사고를 예방하는 관점에서도 중요하다. 공격자에 의해 백도어 프로그램이 설치되거나 시스템 명령이 실행되면 모든 정보를 시스템에 로그로 남길 수 있다. 특히 윈도우 운영체제의 시스템 로그에는 공격 과정에서 발생하는 다양한 정보가 로그에 기록된다.

시스템 로그는 중요성 만큼 기록하는 정보가 많다. 운영체제의 로그 설정에 따라 보관할 수 있는 기간도 다르기 때문에 분석가나 실시간 모니터링 관점에서는 로그를 XDR 플랫폼과 연동해서 사고 분석 과정에서 활용하거나 실시간 위협 탐지를 위해 활용한다.

사고가 발생할 경우 사고조사를 수행하는 분석가 입장에서는 피해 범위를 파악하기 위해 모든 시스템을 일일이 확이할 수 없기 때문에 시스템 로그를 수집해서 식별된 IOC와 연관된 시스템 로그를 분석해서 사고 피해 범위를 유추한다. 이후 파악된 시스템의 디지털 포렌식 작업이나 2차 상세 점검을 수행하는게 효율적으로 사고 분석을 수행할 수 있다.

실시간으로 수집되는 시스템 로그에는 시스템 운영과 관련된 다양한 정보가 수집된다. 보안팀에게는 실시간 보안 위협과 관련된 정보가 실시간으로 전달된다. 원격에서 공격을 시도할 경우 시스템에 접근하려는 시도가 로그를 통해 수집된다. 공격을 시도하는 원격 IP나 시스템에서 외부로 연결되는 백도어 IP를 수집해 모니터링 할 수 있다. 실시간 모니터를 위해서 보안팀은 오픈 소스 기반의 인텔리전스 (OSINT)를 활용 힐 수 있다.

엘라스틱(Elastic) SIEM 대시보드 feat. 클로바더빙

SIEM 플랫폼(Elastic SIEM)을 이용한 Threat Hunting 악성코드 감염 경로 분석 데모

네트워크 정보 수집

방화벽 허용 로그에는 4계층 기반의 통신 정보 활용이 가능 하다. 네트워크 통신을 주고 받은 IP 주소와 서비스 포트, 프로토콜, 통신량(byte) 등 활용이 가능 하다.

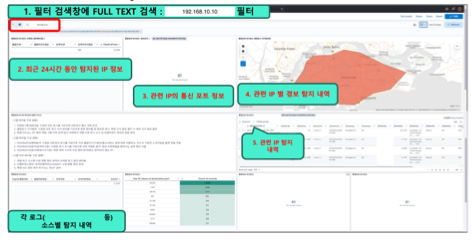

앞서 로그와 프로세스 정보 분석을 통해 공격 받은 시스템을 분석하는 방법을 살펴 보았다. 공격이 발생한 시스템이 확인되면 사고가 발생한 시간과 사고 발생 IP 주소를 키워드로 네트워크 통신 내역을 추적한다. 방화벽 허용 로그 검색을 통해서 공격 경로를 분석 한다. 다음은 네트워크 방화벽 허용 로그다.

| Sep 25 19:02:42 192.168.0.1 %ASA-6-302015: Built outbound UDP connection 35484054 for outside:10.0.1.127/137 (10.0.1.127/137) to inside:10.0.1.124/137 (10.0.1.124/137) Sep 25 19:04:45 192.168.0.1 %ASA-6-302016: Teardown UDP connection 35484054 for outside:10.0.1.127/137 to inside:10.0.1.124/137 duration 0:02:02 bytes 150 Sep 25 19:10:20 192.168.0.1 %ASA-6-302015: Built outbound UDP connection 35484817 for outside:10.0.1.127/138 (10.0.1.127/138) to inside:10.0.1.124/138 (10.0.1.124/138) Sep 25 19:12:22 192.168.0.1 %ASA-6-302016: Teardown UDP connection 35484817 for outside:10.0.1.127/138 to inside:10.0.1.124/138 duration 0:02:01 bytes 201 Sep 25 19:13:02 192.168.0.1 %ASA-6-302013: Built inbound TCP connection 35485033 for outside:192.168.0.118/51879 (192.168.0.118/51879) to inside:10.0.1.124/80 (10.0.1.124/80) Sep 25 19:13:02 192.168.0.1 %ASA-6-302014: Teardown TCP connection 35485033 for outside:192.168.0.118/51879 to inside:10.0.1.124/80 duration 0:00:00 bytes 0 TCP Reset-I Sep 25 19:13:02 192.168.0.1 %ASA-6-302013: Built inbound TCP connection 35485035 for outside:192.168.0.118/51879 (192.168.0.118/51879) to inside:10.0.1.124/80 (10.0.1.124/80) Sep 25 19:13:02 192.168.0.1 %ASA-6-302014: Teardown TCP connection 35485035 for outside:192.168.0.118/51879 to inside:10.0.1.124/80 duration 0:00:00 bytes 0 TCP Reset-I Sep 25 19:13:03 192.168.0.1 %ASA-6-302013: Built inbound TCP connection 35485036 for outside:192.168.0.118/51879 (192.168.0.118/51879) to inside:10.0.1.124/80 (10.0.1.124/80) |

수집한 방화벽 허용 로그에서 공격자 IP정보를 검색 후 접근한 시간과 통신 내역을 확인한다. 방화벽 로그에서 통신에 사용된 포트와 통신 시간, 통신량(byte) 정보를 확인한 수 있다. 이 정보는 공격자가 얼마나 많은 데이터 통신을 했는지 추축하는데 사용된다. 만약 FTP 통신을 통해 대용량의 통신을 주고 받았다면 자료 유출이 발생했을 가능성이 있다.

공격자가 현재 활동을 하고 있다면 방화벽 세션 정보를 확인해서 통신을 시도하고 있는 모든 시스템 IP 주소도 확인해 볼 수 있다. 다음은 시스코 방화벽에서 확인한 현재 접속한 세션 정보다.

| TCP out 172.18.0.175:1861 in 10.0.0.34:80 idle 0:00:30 Bytes 815 flags UIOB TCP out 172.19.0.68:33059 in 10.0.0.48:80 idle 0:17:23 Bytes 238 flags UfIB TCP out 172.20.0.151:1049 in 10.0.0.48:80 idle 0:20:34 Bytes 206 flags UfIB TCP out 172.21.0.103:23132 in 10.0.0.48:80 idle 0:02:08 Bytes 238 flags UfIB TCP out 172.16.0.188:3375 in 10.0.0.22:80 idle 0:01:04 Bytes 4564 flags UIOB TCP out 172.16.0.188:3374 in 10.0.0.22:80 idle 0:01:04 Bytes 24638 flags UIOB TCP out 172.16.0.188:3373 in 10.0.0.22:80 idle 0:01:04 Bytes 9557 flags UIOB TCP out 172.17.0.230:25 in 10.0.0.33:4232 idle 0:00:52 Bytes 0 flags saA TCP out 172.22.0.47:1080 in 10.0.0.48:80 idle 0:02:38 Bytes 256 flags UfIB TCP out 172.23.0.36:36474 in 10.0.0.48:80 idle 0:29:44 Bytes 256 flags UfIB |

공격자의 침투 경로를 분석하다 보면 방화벽에 남아 있는 정보로는 정보가 부족하다. 예를 들어 앞서 FTP 통신을 통해서 데이터를 보냈다는 사실은 방화벽 로그를 이용해 확인 할 수 있다. 하지만 어떤 파일이 전송되었는지, 공격자가 접속한 계정 정보가 무엇인지, 몇 개의 파일을 가져갔는지 정보는 알 수 없다.

특히 웹 서버처럼 다양한 변수를 사용하는 경우에는 공격 경로 파악하는데 상세 통신 내역이 반드시 필요하다.

분석에 필요한 정보는 웹 어플리케이션 방화벽이나 침입탐지 시스템에서 일부 확인이 가능하지만 전체 통신 내역을 확인하려면 모든 세션 정보를 수집해야 한다. 이 경우 패킷 수집 솔루션을 활용하지만 전체 패킷을 수집하기 때문에 분석할 정보가 상당히 많다.

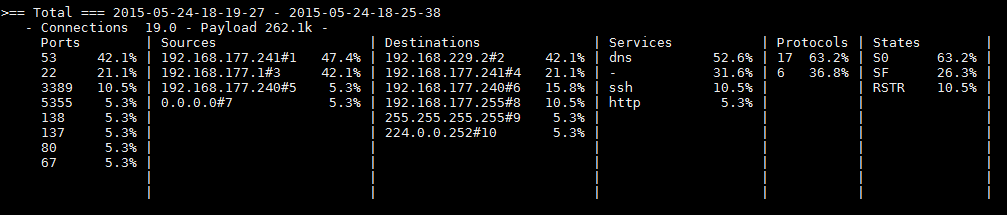

전체 패킷을 수집하지 않아도 세션 정보로도 공격자의 경로 추적은 가능하다. Bro-IDS 프로그램은 오픈 소스 기반으로 네트워크 통신 분석 프로그램이다. 오픈 소스 프로그램에 대한 설명과 간단한 설치 가이드는 별첨 문서를 참고 하자.

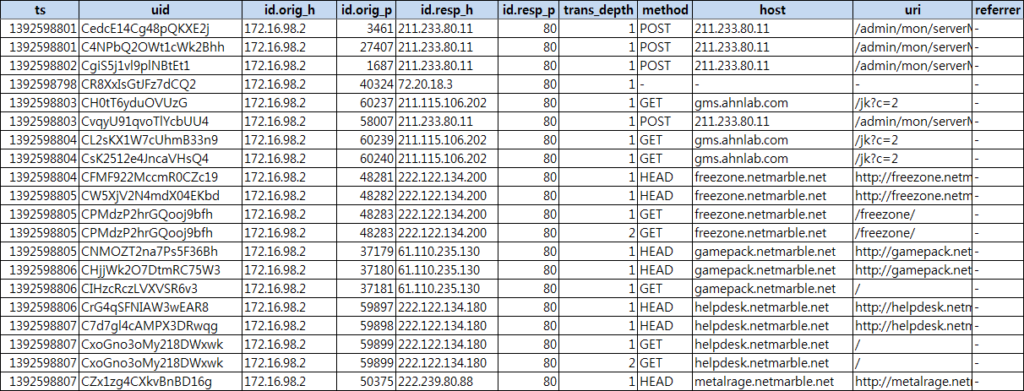

세션[1] 분석 솔루션은 어플리케이션 통신 내역을 모두 수집할 수 있다. 분석가가 공격 경로를 파악하는데 필요한 정보를 제공한다. 다음은 웹 통신 내역을 수집 분석한 로그 샘플이다. URI를 포함해 웹 링크 횟수 및 참조 정보 등 분석에 유용한 다양한 정보를 제공한다.

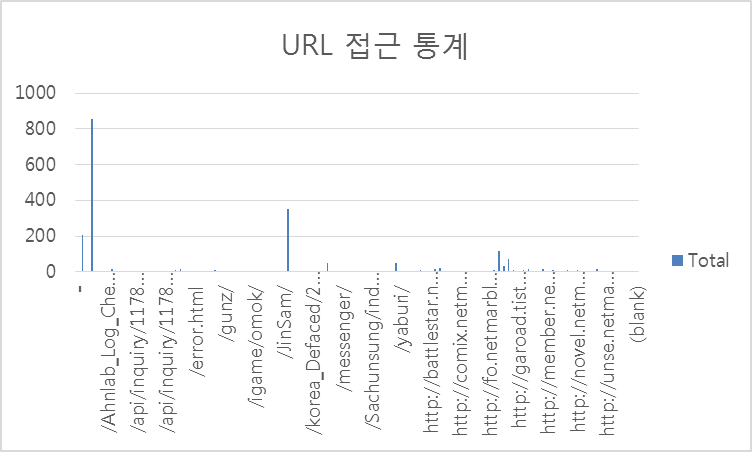

다음은 웹 통신 내역을 수집한 후 엑셀을 이용해 URL 접근 내역을 통계로 작성한 결과다.

공격자 IP가 식별이 되었다면 공격자 IP를 검색 키워드로 URL 목록을 추출하고 접근한 통신 내역을 확인할 수 있다. 추출한 정보는 시간 순서대로 정리한 후 공격자 동선을 파악하는데 사용한다.

세션 분석 솔루션에서 제공하는 정보 중 통신 내역에 대한 통계 정보도 유용하게 활용된다. 해킹에 의해 비정상적으로 발생되는 어플리케이션이나 IP 주소를 찾아내는데 활용할 수 있다. 다음 그림을 보자.

공격자 IP가 식별 되었다면 좀더 쉽게 통신 내역을 분석할 수 있지만 공격자 IP를 식별해야 하는 경우에는 이러한 통계 정보를 활용하면 도움이 된다.

주로 많이 사용되는 통신 포트나 IP 주소를 제외하고 의도하지 않게 사용되고 있는 통신 포트에 주목하자. 악성코드 감염에 의한 현상일 수 있다.

주기적으로 해당 정보를 가공 활용한다면 내부에서 트래픽을 많이 사용하는 IP나 서비스에 대해 식별이 가능하고, 어떤 IP로 사용자 요청이 집중되는지 수치를 통해 확인 가능하다.

용도에 따라 다양하게 활용이 가능하다.

- 내부 서비스 포트 사용 현황

- 가장 많이 접근하는 도착지

- 가장 적게 접근하는 도착지

- 서비스 통계 현황

- 프로토콜 비율

- 패킷 flag별 비율

세션 분석 기반의 솔루션에서 수집할 수 있는 정보를 살펴 봤다. 상세한 통신 정보를 수집하고 공격 경로 분석에 활용하는 것이 핵심이다.

네트워크 기반의 상용 보안 제품도 애플리케이션 분석을 기반으로 이상 행위에 대한 탐지 및 차단 기능을 제공한다.

경우에 따라서 네트워크 상에 주고 받은 모든 패킷을 수집해 위협과 관련된 이상 행위를 찾아내야 할 경우가 있다. 풀 패킷(Full Packet) 파일을 분석하려고 하면 먼저 그 양에 한번 놀라고, 어디서 부터 시작해야 할지에 한번 더 막막함을 느끼게 된다. 이는 어마어마한 양의 네트워크 패킷을 처음부터 끝까지 모두 보려 하기 때문이다. 풀 패킷 분석을 한다고 해서 모든 패킷을 하나하나 다 분석할 필요 없다. 앞서 이벤트 분석 방법론에서 언급했던 것과 마찬가지로 필요한 패킷을 선별적으로 분석하면 된다. 필요한 경우 추가 분석을 진행하면 된다. 모든 패킷을 분석하는 부담감을 버리길 바란다.

선별적으로 이벤트를 분석하기 위해서는 먼저 분석 대상과 분석 범위에 대해서 정의해야 한다. 분석 범위의 기준은 여러가지가 있다. 우리는 이번 장에서 분석 범위의 기준을 비 정상 범위의 대상으로 지정하여 분석하는 방법을 살펴 볼 것이다.

[1] 세션(session) [IT용어] ① 망 환경에서 사용자 간 또는 컴퓨터 간의 대화를 위한 논리적 연결. (출처 네이버)

생성형 AI 기반 보안 대응 업무 활용

인공지능(AI)을 활용하면 보안 경보 분석 업무를 더 효율적이고 쉽게 만들 수 있습니다. 보안 경보 분석에서는 방대한 양의 데이터가 실시간으로 생성되며, 이를 일일이 사람이 분석하기에는 한계가 있습니다. AI 기술을 적용하면 경보 분석에서 발생하는 주요 문제를 해결하고 자동화할 수 있습니다.

다음은 AI를 통해 보안 경보 분석 업무를 쉽게 하는 몇 가지 방법입니다:

1. 이상 탐지(Anomaly Detection)

AI 기반 이상 탐지 알고리즘은 정상적인 활동 패턴을 학습하고 비정상적인 활동을 실시간으로 탐지할 수 있습니다. 머신러닝 모델을 사용하여 평소의 네트워크 트래픽과 행동을 학습한 후, 이와 다른 활동이 나타날 경우 자동으로 경보를 생성하거나 분석 팀에 알림을 보냅니다.

활용 기술:

- 머신러닝 (예: SVM, 랜덤 포레스트)

- 딥러닝 (예: RNN, LSTM)

2. 경보 우선순위 지정

보안 시스템에서는 수많은 경보가 발생하므로 모든 경보를 동일하게 처리하는 것은 비효율적입니다. AI를 통해 경보의 심각도와 우선순위를 자동으로 평가하여 중요한 경보를 먼저 처리할 수 있게 합니다. 이는 경보의 과거 기록, 발생 시간대, 공격 패턴 등을 바탕으로 이루어집니다.

활용 기술:

- 자연어 처리(NLP)를 통한 로그 분석

- 기계 학습 기반의 경보 분류 시스템

3. 오탐지 감소

AI를 활용해 오탐(false positive) 경보를 줄일 수 있습니다. 기계 학습 모델은 반복적인 학습을 통해 오탐 경보의 패턴을 인식하고 이러한 경보가 다시 발생할 때 우선순위를 낮추거나 무시할 수 있게 됩니다. 이렇게 하면 보안팀이 중요한 경보에 더 집중할 수 있게 됩니다.

활용 기술:

- 오탐과 실제 경고 데이터 학습

- 딥러닝을 통한 패턴 인식

4. 자동화된 위협 인텔리전스 통합

AI는 다양한 보안 위협 정보(Threat Intelligence) 소스에서 자동으로 데이터를 수집하고 분석할 수 있습니다. 이를 통해 새로운 위협에 대한 정보를 경보 분석에 통합하여 보다 정확하고 최신의 경보 분석이 가능해집니다.

활용 기술:

- 위협 인텔리전스 플랫폼과의 API 연동

- 빅데이터 분석

5. 보안 이벤트 상관관계 분석

여러 개의 보안 이벤트가 동시에 발생할 때, AI는 이를 상관관계 분석하여 서로 관련 있는 이벤트를 그룹화하거나 특정 공격 시나리오를 식별할 수 있습니다. 이를 통해 개별적으로는 무해해 보이는 이벤트들이 합쳐져 큰 보안 위협을 의미할 수 있음을 탐지할 수 있습니다.

활용 기술:

- 상관관계 분석 알고리즘

- 그래프 분석 및 패턴 매칭

6. 자동 대응 시스템

AI가 경보를 분석하는 동시에 자동 대응을 수행하도록 설정할 수 있습니다. 예를 들어, 의심스러운 활동이 탐지되면 AI가 자동으로 방화벽 규칙을 수정하거나 특정 사용자의 접근 권한을 일시적으로 제한할 수 있습니다.

활용 기술:

- SOAR(Security Orchestration, Automation, and Response) 플랫폼

- 자동화된 정책 실행 엔진

AI 기반 보안 경보 분석 도입의 장점

- 시간 절약: 반복적이고 수작업이 많은 분석 과정을 AI가 자동화하여 보안 팀의 시간을 절약.

- 정확도 향상: AI는 더 많은 데이터를 빠르게 분석하여 사람보다 더 일관되게 정확한 분석을 수행.

- 위협 대응 속도 향상: 실시간 분석 및 자동화된 대응을 통해 위협에 신속히 대처.

이와 같은 AI 활용을 통해 보안 경보 분석의 효율성을 크게 높일 수 있습니다

Elastic 머신 러닝 활용 이상 탐지(Anomaly Detection)

1. Elastic 머신 러닝 소개

Elastic Stack에 통합된 Elastic Machine Learning (ML) 기능은 대규모 데이터를 기반으로 자동화된 통찰력과 예측을 제공하는 강력한 도구입니다. 복잡한 기계 학습 알고리즘을 사용자가 쉽게 적용할 수 있도록 설계되어, 로그, 메트릭, 보안 이벤트 등 다양한 시계열 데이터에서 이상 징후(Anomaly)를 탐지하고 추세(Trend)를 예측하는 데 탁월한 성능을 발휘합니다.

Elastic ML은 크게 비지도 학습(Unsupervised Learning)과 지도 학습(Supervised Learning) 두 가지 유형의 분석을 지원합니다. 옵저버빌리티(observability)와 보안(security) 목적으로 사용되는 경우 비지도 학습을 통해 이상 행위를 분석 합니다. 비지도 학습은 Elastic ML의 핵심 기능으로, 레이블링된 훈련 데이터 없이 데이터 내의 정상적인 행동 패턴을 스스로 학습하여 비정상적인 이벤트를 식별합니다.

비지도 학습 기반의 탐지 방식은 다음과 같습니다.

시계열 기반 이상 징후 탐지 (Anomaly Detection)

- 시계열 기반 이상 징후 탐지 (Anomaly Detection) 방식: 로그, 메트릭 등 시간에 따라 변화하는 데이터에서 비정상적인 패턴을 실시간으로 식별합니다.

- Elasticsearch로 수집된 시계열 데이터에서 정상 상태의 통계적 모델을 자동 생성합니다.새로운 데이터 포인트가 모델에서 예측한 범위를 벗어날 경우, 이를 이상 징후로 플래그하고 **이상 징후 점수(Anomaly Score)**를 부여합니다.

- 이를 통해 시스템 성능 저하, 보안 위협, 애플리케이션 오류 등의 근본 원인을 신속하게 파악할 수 있습니다.

- 활용 사례: 서버의 CPU 사용률 급증, 웹 요청 응답 시간 지연, 네트워크 트래픽의 비정상적인 증가 등을 모니터링합니다.

예측 (Forecasting) 방식

- 예측 (Forecasting) 방식: 과거의 데이터 패턴을 기반으로 미래의 데이터 동작을 예측합니다.

- 활용 사례: 향후 리소스 요구 사항(예: 스토리지, 서버 부하)을 예측하여 용량 계획(Capacity Planning)에 활용하거나, 이상 징후가 발생하기 전에 선제적으로 대응합니다.

이상값 탐지 (Outlier Detection)

- 이상값 탐지 (Outlier Detection) 방식: 시계열 데이터가 아닌 정적인 데이터 세트에서 다른 데이터 포인트와 크게 동떨어진 개별 데이터 포인트를 식별합니다.

- 활용 사례: 사기 거래 탐지, 비정상적인 사용자 행동 분석 등에 사용됩니다.

지도 학습은 레이블링된 훈련 데이터 세트를 사용하여 모델을 구축하고, 이를 통해 새로운 데이터의 범주(분류)나 연속적인 값(회귀)을 예측합니다.

지도 학습 기반의 탐지 방식은 다음과 같습니다.

분류 (Classification)

- 분류 (Classification) 방식: 데이터 포인트를 이산적인 범주형 값으로 예측합니다 (예: 악성/정상, 스팸/비 스팸).

- 활용 사례: 보안 분야에서 잠재적인 악성 도메인 요청을 분류하거나, 사용자 피드백을 긍정/부정으로 분류합니다.

회귀 (Regression)

- 분류 (Classification) 방식: 데이터 포인트를 이산적인 범주형 값으로 예측합니다 (예: 악성/정상, 스팸/비 스팸).

- 활용 사례: 보안 분야에서 잠재적인 악성 도메인 요청을 분류하거나, 사용자 피드백을 긍정/부정으로 분류합니다.

2. 머신 러닝 유즈케이스: 네트워크 이상 통신 분석

인프라팀과 보안팀에서는 네트워크 기반의 이상 행위 또는 이상 트래픽을 모니터하기 위해 다양한 장비의 로그를 수집해서 분석 합니다. 네트워크 기반의 로그의 경우 TCP/IP 기반의 네트워크 프로토콜 정보를 제공 합니다.

보안 위협을 식별하는 방법은 다양하며, 문자열로 된 공격 특징을 패턴으로 정의하여 공격을 식별하거나 특정 파일명 또는 IP 주소, 시스템 명령이 포함되지 않은 통신에서 관련 명령어 실행 여부 검색 등을 통해 보안 위협을 식별할 수 있습니다. 패턴 기반 식별 방법은 공격을 빠르게 구분하고 식별할 수 있어 가장 많이 사용되지만 공격과 관련된 패턴을 모르는 경우에는 탐지할 수 없거나 위협을 놓칠 수 있는 단점이 있습니다.

이러한 단점을 극복하고, 탐지 패턴을 알 수 없거나 제로데이 공격 위협을 식별하기 위해 이상 행위 분석(Anomaly Detection) 방법이 사용됩니다. 이상 행위 분석은 공격 특징을 가진 정형화된 공격이 아닌 비정형화된 공격을 탐지하기 위해 행위 분석을 통해 보안 위협을 식별하는 방식입니다.

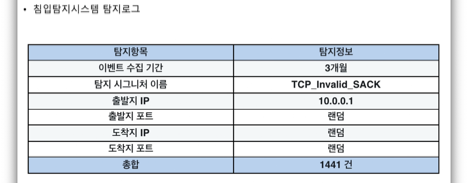

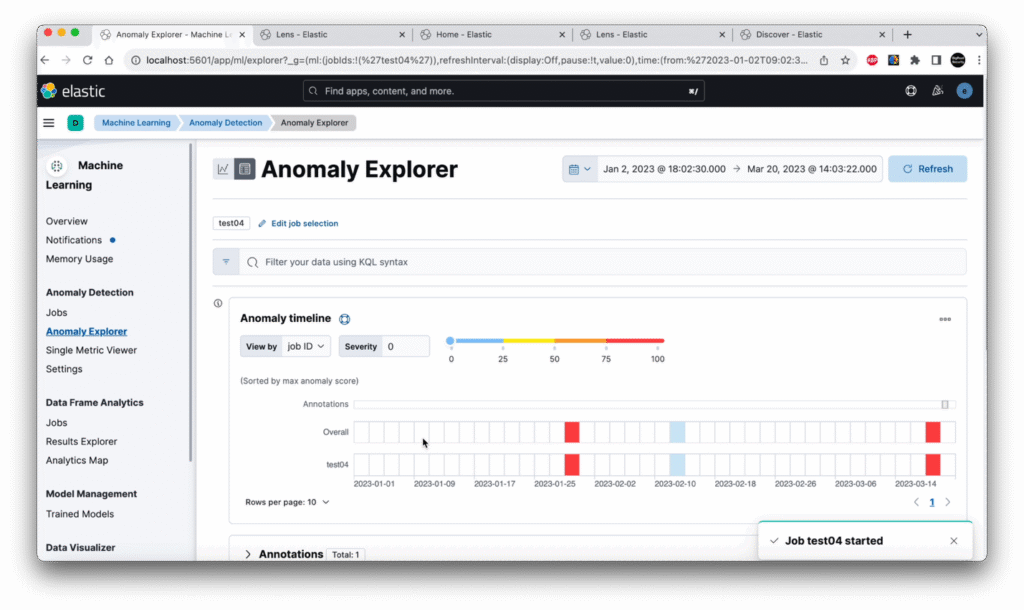

네트워크 TCP/IP 기반의 로그 정보를 이용해 보안 위협 관점에서 이상 행위 분석 과정을 상세히 살펴봅니다. 보안 솔루션의 탐지 로그(CSV 형식, 구분자 쉼표)를 사용하며, 총 8개의 컬럼(탐지 시간, 이벤트 탐지 카운트, 출발지 IP/PORT, 도착지 IP/포트, 오브젝트 타입, 프로토콜 유형)을 가진 로그입니다.

Kibana의 Visualize 기능을 사용하여 날짜별 통신 통계 정보를 표(Table)로 작성할 수 있습니다. 간단하게 통신 내역 통계를 확인할 수 있습니다.

하지만 실제 이상 행위에 대한 분석과 이상 행위에 대한 근거를 찾기는 어렵습니다. 수동 분석은 분석가의 역량에 따라 결과의 차이가 발생할 수 있기 때문에 분석 역량 편차를 극복하기 위해 머신러닝을 활용 할 수 있습니다. 앞서 표에 사용했던 포트 통신 정보를 머신 러닝 학습에 사용할 수 있습니다.

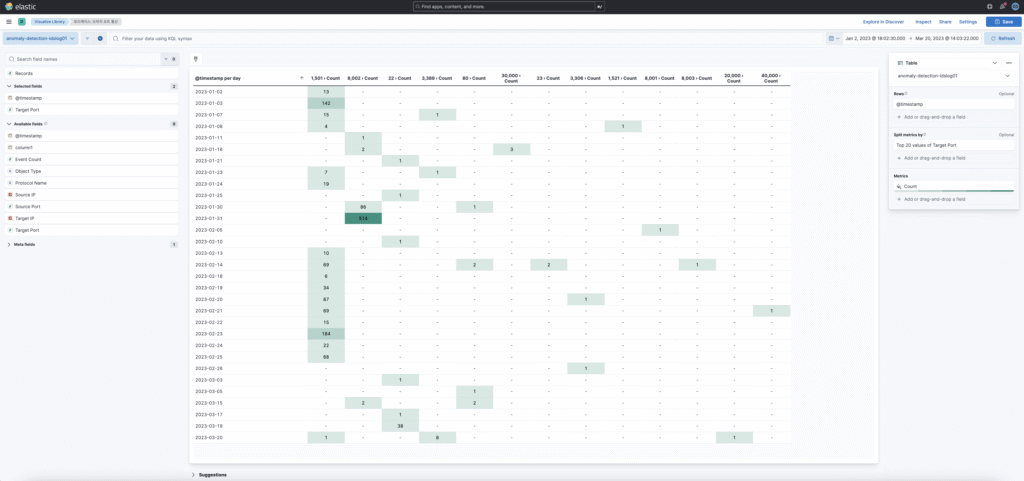

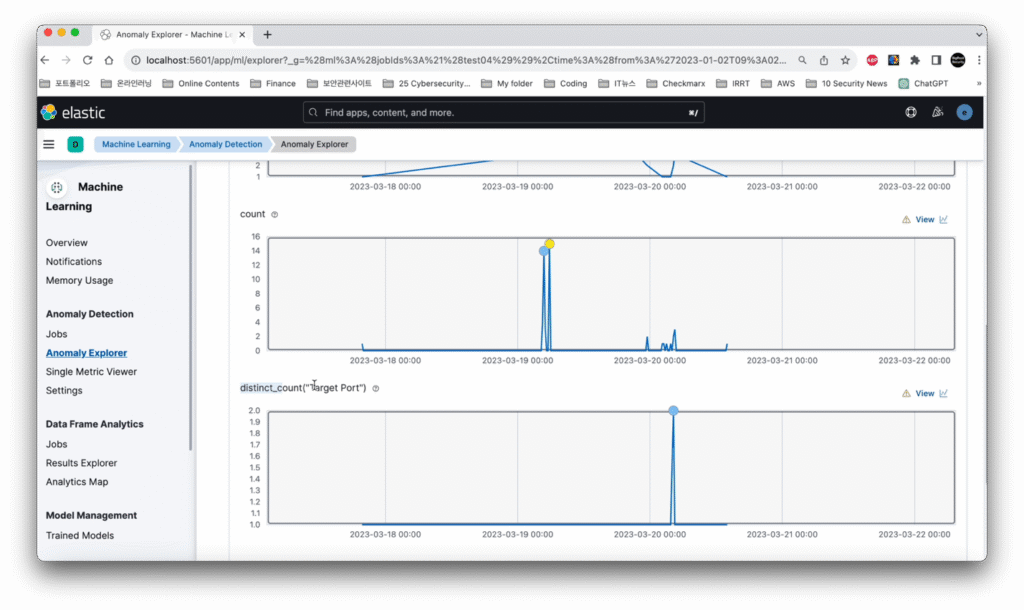

분석 과정은 다음과 같습니다. 통신 로그 분석을 통해 이상 행위에 대한 식별이 가능 합니다. 머신러닝을 이용한 이상 행위 분석은 Analytics 메뉴의 Anomaly Detection 기능을 사용하여 수행됩니다.

IDS 로그를 대상으로 도착지 IP, 도착지 포트, 이벤트 탐지 카운트를 선택하여 멀티 메트릭 분석을 진행 합니다.

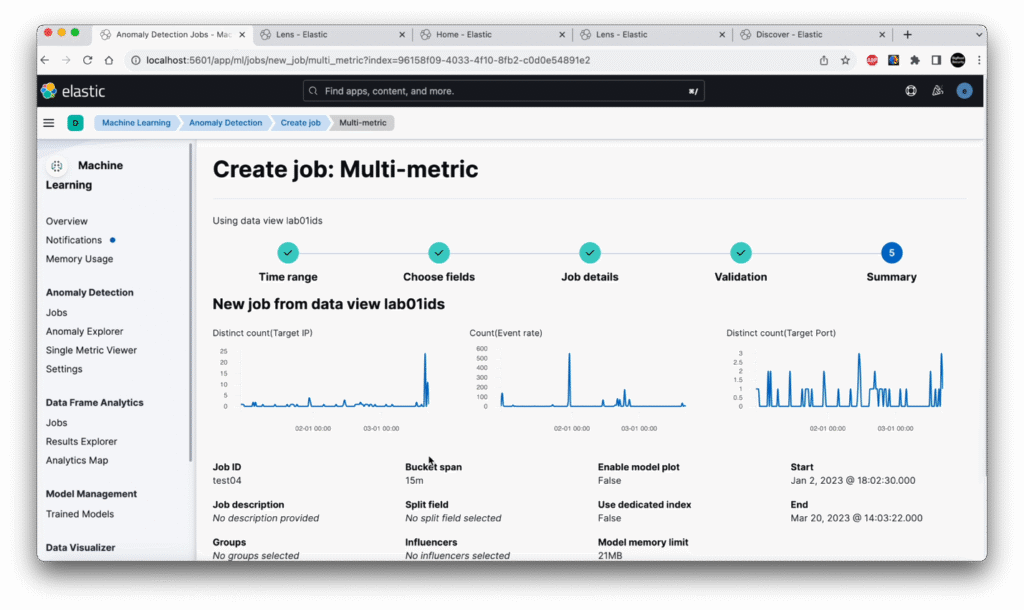

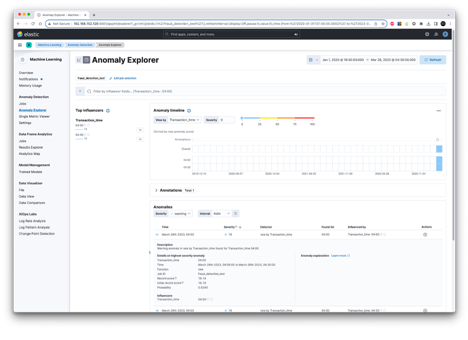

분석 완료 후 결과 보기를 통해 의심 행위를 확인할 수 있으며, 이상 행위가 식별된 타임라인은 빨간색으로 표기됩니다.

분석 그래프를 보면 3월 18일부터 그래프가 갑자기 증가된 것이 확인되며, 자세한 시간 정보에서는 이상 행위에 대한 스코어와 근거를 확인할 수 있습니다.

대상 IP 기준으로 분석된 내용을 보면 평소 1회 탐지되던 패턴이 11배로 증가하여 평소와 비정상적인 이상 현상이 발생했으며, 도착지 포트 탐지 횟수도 3월 19일 증가된 것을 확인했습니다. 통신 시간을 상세 분석한 결과, 새벽 05시에 통신이 집중되었으며, 몇 초 간격으로 서로 다른 도착지 IP로 통신이 이루어진 것을 확인했습니다. 이는 시스템 관리자가 SSH 통신을 하는 일반적인 간격(몇 분 이상)과 달리 아주 짧은 간격으로 발생했고3월 19일 하루만 갑자기 발생했다는 점에서 비정상적인 행위로 판단되었습니다.

결과적으로, 머신러닝을 통해 분석가의 편차와 상관없이22번 도착지 포트의 이상 행위와 대상 IP에 대한 이상 현상을 정확하게 식별할 수 있었습니다.

영상: https://youtu.be/EKV1gZjxPkU?si=iyigokW4TafX09ob

3. 머신 러닝 유즈케이스: 이상 ISP 식별

Elastic 머신 러닝 기능을 활용하여 네트워크 로그에서 잠재적인 보안 위협을 탐지하는 기술적 접근 방식은 조직의 보안 운영을 강화하는 핵심 유즈케이스 입니다.

특히 평소 네트워크 활동에서 관찰되지 않던 희귀한 ISP(Internet Service Provider) 정보나 새로운 ASN(Autonomous System Number)을 가진 대상과의 통신 패턴을 탐지하는 것은 무단 액세스나 데이터 유출 시도를 식별하는 매우 중요한 방법 중 하나입니다. 이러한 통신은 일반적인 비즈니스 트래픽이나 내부 사용자 활동에서는 전혀 예상되지 않는 주체와의 연결을 의미하며, 공격자가 숨겨진 인프라를 사용하고 있을 때 나타나는 의심스러운 징후가 됩니다.

이러한 유즈케이스를 탐지하기 위해 우리는 Elastic ML의 비지도 학습 기능(Unsupervised Learning)을 사용하여 네트워크 데이터의 정상적인 패턴을 학습하고 이 패턴에서 벗어나는 행위, 즉 희귀 이벤트(Rare Events)를 자동으로 찾아냅니다. 사용되는 ML Job은 RARE 디텍터를 이용합니다.

시간이 지남에 따라 각 대상의 ISP/ASN 정보별로 관찰되는 네트워크 활동의 정상 범위를 모델링하고 이 범위를 벗어나는 희귀한 활동을 이상 징후로 탐지합니다.

이 ML Job은 특정 대상의 ISP 또는 ASN 필드를 분석하고, 네트워크 트래픽 건수(count 함수)를 측정 지표로 사용합니다. 시간에 따른 각 대상 주체별 트래픽 패턴을 개별적으로 분석하여 평소 거의 혹은 전혀 트래픽이 발생하지 않던 ISP와 갑자기 통신이 증가하는 경우에 높은 이상 징후 점수(Anomaly Score)를 부여합니다.

- 한국 ISP 출발지

- 도착지 국가 정보가 한국

- 로그 필터 : source.geo.country_name: “South Korea” and network.transport: “TCP”

탐지된 이상 징후는 Kibana의 Anomaly Explorer에서 시각화되어 보안 담당자가 쉽게 확인하고 영향 요인(Influencers)을 분석할 수 있으며, 이때 대상 ISP 또는 ASN 필드와 트래픽 건수가 주요 영향 요인으로 표시되어 이상 활동의 근본 원인을 빠르게 파악할 수 있습니다.

특히 취약한 보안으로 해킹 중간 경유지로 사용되는 경우 대학/개인공유기/특정기관에서 사용하는 IP 정보와 연관되는 경우가 있습니다.

이를 통해 보안 팀은 공격자가 사용하는 희귀한 C2(Command and Control) 인프라와의 통신을 자동화된 방식으로 식별하고 신속하게 대응함으로써 조직의 민감한 정보를 보호할 수 있습니다.

4. 머신 러닝 유즈케이스: 알려지지 않은 신규 보안 위협 탐지

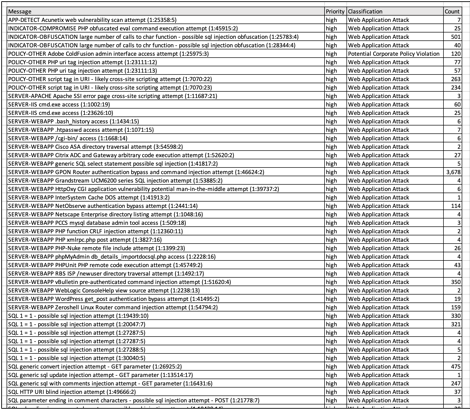

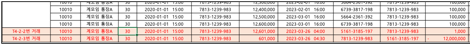

다수의 보안 장비에서 수집되는 공격 이벤트(알람)에는 고유의 이벤트(알람) 이름을 가지고 있습니다. 다음은 한달 동안 IPS에서 탐지된 이벤트 목록을 테이블로 정리한 예제 입니다.

탐지되는 공격 유형은 다양하고 하루에도 똑같은 이벤트가 수천 건 이상 탐지되고 이벤트를 발생 시킵니다. 반복적으로 발생되는 이벤트(알람)은 예외 처리를 통해 최적화 하고 이벤트 탐지 건수를 최적화해야 합니다. 이를 통해 공격과 연관된 이벤트에 집중할 수 있어야 합니다.

하지만 실제 운영 과정에서 모든 보안 이벤트를 최적화하는 작업은 쉽지 않습니다. 새로운 보안 위협을 식별하고 공격자에 의해 새롭게 발생하는 공격 탐지 이벤트(알람)를 식별하는 것은 기업 인프라를 보호하는 데 매우 중요한 유즈케이스 입니다.

머신 러닝을 통해 반복적으로 발생하는 이벤트를 제외하고 특정 기간 동안 탐지 되지 않은 보안 이벤트(알람)가 발생할 경우 보안팀에서 인지할 수 있다면 새로운 공격 위협이나 심각한 공격 행위를 구분하는데 매우 효율적으로 대응할 수 있습니다.

머신 러닝을 이용해 희귀(Rare) 조건의 데이터를 학습하고 자동으로 새로운 위험을 구분 합니다. Elastic Security로 수집된 인덱스에서 목적에 맞는 데이터를 추출하여 별도의 데이터셋을 생성한 후 ML학습을 수행할 수 있으며 운영자는 학습 결과를 스코어링(또는 그래프)와 같이 직관적으로 확인할 수 있도록 기능을 제공하고 있습니다. (※ ML Job 생성 및 확인). 아래는 실제 보안솔루션(IPS / 웹방화벽 / DDoS 대응 솔루션)에서 탐지된 이벤트를 추출하여 Rare 함수 기반 ML학습을 수행한 결과 일부입니다.

Elastic Security는 생성된 ML Job 의 스코어링 값(1~ 99)을 기준으로 ML 룰을 작성할 수 있습니다. 아래는 작성된 ML룰에 의해 탐지된 Alerts입니다. 보안 장비(DDoS/WAF/IPS) 이벤트(알람)를 기준으로 최근 한달 동안 탐지되지 않던 이벤트(알람)이 발생하면 머신 러닝 학습을 통해 경보를 발생 합니다.

5. 머신 러닝 유즈케이스: 네트워크 이상 트래픽 모니터

비정상적으로 크게 급증하는 패턴을 탐지하는 것은 서비스 가용성을 확보하는데 가장 중요한 방법 중 하나입니다. 일반적인 비즈니스 흐름이나 네트워크 운영에서 전혀 예상되지 않는 트래픽이 발생할 때 더욱 의심스러운 징후가 됩니다. 이는 내부 시스템에서 외부의 악의적인 대상으로 대량의 데이터가 전송될 수 있으며, 외부에서 내부로 비정상적인 네트워크 연결 증가나 실패는 서비스 제공에 심각한 문제가 발생한 징후일 수 있습니다.

이러한 유즈케이스를 탐지하기 위해 우리는 Elastic ML의 비지도 학습 기능을 사용하여 네트워크 데이터의 정상적인 패턴을 학습하고 이 패턴에서 벗어나는 행위를 자동으로 찾아냅니다. 사용되는 ML Job high_count와 같은 형태로 정의될 수 있는데, 이는 네트워크 활동의 정상 범위를 모델링하고 이 범위를 벗어나는 활동을 이상 징후로 탐지합니다.

실제 국내 운영 사례로 다음과 같이 프토토콜에 따른 트래픽을 학습하고 이상 징후를 선제적으로 대응에 활용되는 사례를 설명 합니다.

유즈케이스: TCP/UDP/ICMP/TLS 기반 High Count 머신 러닝 룰

| Job/Rule 명 | 분석 목적 | 필드 데이터 |

| protocol_pps_rcvd | PPS/수신 바이트 급증 | pps.packets_pps : 수집 트래픽 내 유입량 정보(패킷 수 기반) |

| protocol_udp_bytes | UDP 트래픽 급증 | 수집 트래픽 내 유입량 정보(Inbound 기반) |

| protocol_tcp_bytes | TCP 트래픽 급증 | procotol.*.bytes : 수집 트래픽 내 각 프로토콜 별 유입량 정보 |

| http_bytes | 웹 트래픽(HTTP) 급증 | procotol.*.bytes : 수집 트래픽 내 각 프로토콜 별 유입량 정보 |

| anomaly_outbound | 아웃바운드 의심 트래픽 | tx_rx.sent_bytes : 수집 트래픽 내 유입량 정보(Outbound 기반) |

유즈케이스: TCP/UDP/ICMP/TLS 기반 High Count 머신 러닝 운영 팁

- Bucket Span 조정 목표: 단발성 트래픽 스파이크로 인한 오탐(False Positive)을 줄이고, 이상 트래픽이 지속되는 패턴을 더 명확하게 식별하여 탐지 명확도를 높이는 데 중점을 두었으며, 이를 통해 최적화 튜닝을 진행했습니다.

- 룰의 민감도 및 정확도 개선을 위해 주요 ML 룰의 Bucket Span 설정을 기존 1분에서 10분 단위로 조정하여 탐지 성능 개선

- 기존 1분 단위로 판단을 진행하고 있으며, 이로 인해 단기간에 1회성으로 발생한 통신에 대해서도 높은 점수로 평가되는 경향을 보여 5~10분 단위로 분석 주기를 늘려 탐지 프로필의 정교함을 증가 시킵니다.

- 트래픽 유입량(bps) 및 패킷 건수(pps)를 기반으로 분석을 수행해 데이터 값이 평시대비 커지긴 하였으나, 절대적인 수치는 낮은 경우(몇 백 kbits)가 높은 점수로 평가되는 경향을 보여 다수의 탐지 사례가 발생하기 때문에 출발지 IP의 Unique Count를 분석 데이터에 포함하여, 출발지 IP가 함께 상승하는 경우를 탐지(DDoS의 특징을 고려)

유즈케이스 탐지 예제: 머신 러닝을 통해서 아웃바운드 통신 급증 경보 발생

- @timestamp: Aug 27, 2024 @ 14:53:06.221

- 출발지 IP: 192.168.221.128

- 도착지 IP: 185.125.190.36 / Country GB, Continent EU, Network 185.125.190.0/24

- kibana.alert.rule.type: machine_learning

탐지된 정보를 활용해 대시보드를 구성할 수 있습니다. 보안 유즈케이스와 인프라 모니터 유즈케이스 모두 해당 합니다. 다음은 샘플 화면 사례 입니다.

탐지된 정보를 기반으로 의심 국가나 지리정보를 기반으로 심층 분석 진행으로 이어 집니다.

6. 머신 러닝 유즈케이스: 개인업무 고객정보조회 모니터

개인정보 유출 사고가 발생하면 기업 입장에서 중요한 비지니스 영향을 받습니다. 사고 조사 과정에서 개인정보 유출 시점에 일반적인 업무 절차와 다른 다양한 이상 징후가 확인 됩니다. 대표적인 개인정보 유출 사례를 다음과 같습니다.

- 권한 오남용: 고객 정보에 접근 권한을 가진 내부자가 권한을 악용하여 비정상적으로 다량의 정보를 조회(예: 비정상적인 조회 패턴)하는 행위를 식별합니다.

- 보안 사고: 개인정보 유출 사고 발생 시 대량의 정보 유출로 인한 이상 트래픽 발생이나 의심스러운 네트워크 통신을 통해 정보 유출 행위를 식별 합니다.

Elastic 머신 러닝을 활용해 정보 유출 의심 사례를 탐지한 사례를 살펴 보겠습니다. Elastic 머신 러닝은 다양한 조건을 이용해 정보 유출 행위를 탐지 합니다. 평소 정상 활동에 대한 패턴 학습을 통해 비정상적인 활동에 대한 임계치를 자동으로 생성 하고 임계치를 초과할 경우 경보를 통해 자동으로 알람을 발생 시킵니다.

| 머신러닝(ML) 학습유형 | 설명 | ML 설정 요소 |

| 단일 메트릭 이상 탐지 (Single Metric Anomaly Detection) | 평소 조회 건수의 시간별/일별 패턴을 학습하여, 갑작스러운 조회 건수의 급증을 탐지합니다. | Detector: high_count (조회 건수) |

| 다중 메트릭 이상 탐지 (Multi-Metric Anomaly Detection) | 전체 조직의 조회 건수 패턴을 학습하는 동시에, 각 사용자(user.id) 별로 메트릭을 분리(Split by)하여 개별 사용자의 비정상적인 행동을 정교하게 탐지합니다. | Detector: high_count (조회 건수) Split by: user.id (직원 계정) |

| 모집단 이상 탐지 (Population) | 조직 내 다수의 직원이 특정 시점에 공통적으로 비정상적인 시간대에 조회하는 경우(예: 주말 새벽) 또는 평소 사용하지 않던 **희귀한 애플리케이션(application.name)**을 통해 조회하는 행위를 탐지합니다. | Detector: high_non_zero_count Influencer Field: user.id, application.name |

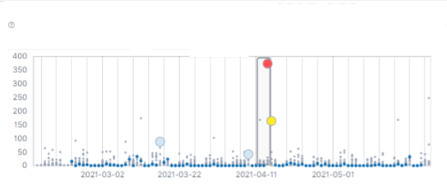

개인업무 고객정보조회 건수 모니터 사례

- 직원정보, 고객 정보 조회 대응

영업점에서 근무하는 직원들의 고객정보화면 조회 건수를 학습하여, 타 직원에 비하여 많은 고객정보조회를 하는 직원 식별 목적의 머신 러닝 적용 사례를 소개 합니다.

그림. 임직원 고객 정보 조회 건수 머신 러닝 분석 결과

권한 없는 사용자가 특정 날짜에 고객정보 조회를 과도하게 조회할 경우 다음과 같이 기존 학습한 개인 정보 조회 건수를 기반으로 이상 행위를 탐지 합니다. 급격히 개인정보 조회건수가 증가하여 개인정보 유출 징후를 식별 할 수 있습니다.

실제 정보 유출에 연관되지 않았지만 가맹점에서 마케팅 목적으로 회원 정보에 대한 조회가 평소 대비 급증하였고, 개인 정보 유출 상황에 대해 적극적으로 탐지/대응이 가능 합니다.

퇴직자 또는 퇴직 예정자의 업무 시스템별 이상 행위 모니터

- 퇴직자 또는 퇴직 예정자의 업무시스템별 사용량 패턴 및 이상행위를 탐지

퇴직자 또는 퇴직 예정자의 평소 업무 시스템별 사용량을 기반으로 퇴직 전후의 이상 사용량 패턴을 분석 합니다.

| 징후 유형 | 상세 설명 | 머신 러닝 (ML) 학습 방식 |

| 비업무 시간 접근 | 직원의 일반적인 근무 시간이 아닌 새벽, 주말, 공휴일에 고객 정보를 조회하는 행위. | Time Series Anomaly Detection, time_of_day 함수 |

| 특정 기간 급증 | 단기간(예: 1시간, 1일) 동안 조회량이 이전 30일 평균 대비 임계치를 초과하여 폭발적으로 증가하는 경우. | high_count Detector, Influencer로 time 필드 사용 |

| 희귀한 대상 접근 | 해당 직원이 평소 업무와 무관한 특정 고객군(예: VIP 고객 명단, 파산 고객 명단)의 정보를 조회한 경우. | rare Detector, Partition Field로 customer.type 사용 |

다양한 개인정보 또는 정보보호 솔루션을 이용해 평소 학습량을 분석 합니다. 아래는 샘플로 복합기/정보보호 프라이버시 솔루션/자료반출승인 관련 시스템의 로그 정보를 학습해 평소 대비 이상 징후와 연관된 사용자를 식별할 수 있습니다.

7. 머신 러닝 유즈케이스: 이상거래탐지

금융 거래 중 보이스 피싱 또는 최근 보이스피싱과 피싱 사기는 갈수록 지능화되고 있으며, 범죄 수익금을 은닉하고 세탁하기 위해 대포통장 활용이 급증하고 있습니다. 금융기관의 기존 FDS(Fraud Detection System)는 주로 단순 임계값이나 미리 정의된 규칙(Rule-based)에 의존하기 때문에, 범죄자들이 이 규칙을 우회하는 새롭고 미묘한 이상 패턴을 실시간으로 포착하는 데 한계가 있습니다.

사기거래 탐지 유즈케이스 한계

- 정적 규칙 의존: 규칙 기반 시스템은 알려진 공격 패턴에만 효과적이며, 신종 수법이나 변형된 패턴에 취약합니다.

- 오탐(False Positive) 증가: 민감도를 높이기 위해 규칙을 강화할 경우 정상 거래까지 이상 거래로 분류하여 사용자 불편과 분석가의 피로도를 증가시킵니다.

- 탐지 지연: 사기 행위가 완료된 후, 데이터를 사후 분석(Post-process)하는 경우가 많아 실시간 대응이 어렵고 피해 확산을 막기 어렵습니다.

Elastic 머신러닝(ML) FDS의 역할

Elastic Machine Learning 기반 FDS는 거래 데이터의 정상적인 행동 패턴을 스스로 학습하고, 정상 범위를 벗어나는 모든 비정상적인 행위(이상 징후, Anomaly)를 실시간으로 식별하여 이러한 한계를 극복합니다. 이는 대포통장을 통한 자금 이동의 특이성과 연속적인 행위를 포착하는 데 필수적입니다.

대포통장이 보이스피싱에 연루될 경우, 범죄자들은 피해금을 신속하게 분산시키거나 인출하기 위해 일련의 비정상적인 거래 시퀀스를 발생시킵니다. Elastic 머신러닝(ML)은 이러한 점검/테스트 행위와 “대량 인출 행위”의 연관성을 탐지하는 데 집중합니다.

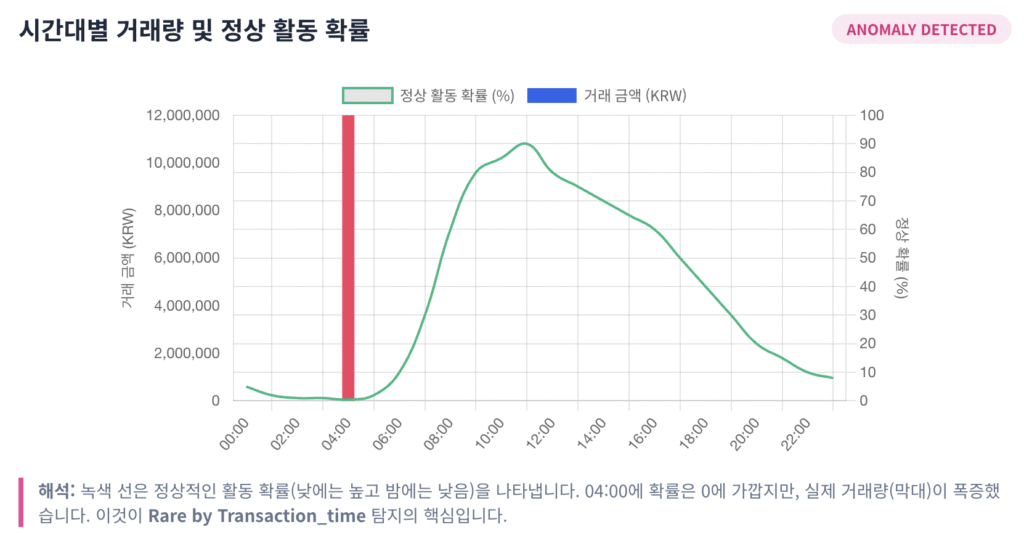

사례 1: 미사용 계좌의 갑작스러운 고액 거래 및 시간대 이탈

시나리오: 오랫동안 사용되지 않던 계좌(대포통장)가 평소 거래가 전혀 없던 시간대에 활성화되어 소액(1,000원)을 입금한 후, 30분 뒤 고액(1,200만 원)을 인출하는 행위.

이상 징후:

- 범인이 4시에 A 통장의 거래 가능 상태 여부를 확인하기 위해 1천원을 입금했다.

- 30분 뒤 범인 E가 A 통장에서 1,200만원을 인출했다.

이상 행위 발생 순서

- 범인이 4시에 A 통장의 거래 가능 상태 여부를 확인하기 위해 1천원을 입금했다.

- 한번도 거래 한적이 없던 계좌를 통해 거래 확인

- 시간대 이탈: 계좌 주인(혹은 피해자)의 평소 입출금 활동 시간대가 아닌 희귀한 시간대에 거래 발생.

- 범인이 30분 뒤A 통장에서 1,200만원을 인출했다.

- 최초 거래 주체: 거래 내역이 없던 **새로운 계좌(범인 계좌)**를 통해 거래 확인

- 한번도 거래 한적이 없던 계좌를 통해, 평소 입출금이 발생하는 시간이 아닌 시간에 처음 거래 발생

Elastic Machine Learning 적용 방안

대포통장 연관 이상 행위 탐지를 위해 Elastic Stack은 비지도 학습(Unsupervised ML) 기반의 이상 징후 탐지를 사용합니다.

- 비지도 학습: 희귀 패턴 탐지 (Rare Function): 대포통장 활성화는 전체 거래 모집단에서 매우 드문 이벤트이므로, Rare 함수를 활용하여 새로운 조합의 행위를 탐지합니다.

- ML Job 유형: Anomaly Detection – Rare (희귀 함수)

- 탐지 필드: Transaction_time (거래 시간)과 Withdrawal_Account (출금 계좌) 조합.

작동 원리: 평소 특정 시간대에 특정 계좌를 통해 거래가 이루어질 확률을 모델링하고, 새로운 계좌가 비정상적인 시간대에 거래하는 행위를 높은 이상 징후 점수로 식별합니다.

- 이상 징후 시간: 2023년 3월 26일 04:00 (Severity: Warning)

- 탐지 이유: rare by Transaction_time (거래 시간 기준 희귀 이벤트)

- 영향 요인 (Influencers):

- Transaction_time: 04:00 (접속한 적 없는 비정상적인 시간대)

- Withdrawal_Account: 5161-3185-197 (한 번도 거래한 적 없던 계좌)

Elastic 머신러닝(ML) 기반 FDS는 실시간으로 진화하는 보이스피싱 및 대포통장 사기 수법에 효과적으로 대응할 수 있는 필수적인 기술입니다. 단순 규칙 기반 탐지에서 벗어나 데이터의 본질적인 특이성과 복합적인 거래 시퀀스를 학습하고 분석함으로써, 금융기관은 사기 피해를 최소화하고 고객의 자산을 보호할 수 있습니다.

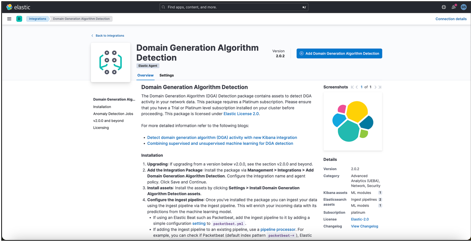

8. 머신 러닝 유즈케이스: 악성코드 배포 탐지

도메인 생성 알고리즘(Domain Generation Algorithm, DGA)은 악성코드 제작자가 감염된 클라이언트 컴퓨터와 명령 및 제어(C2) 서버 간의 통신을 숨기기 위해 사용하는 기술입니다.

- Domain Generation Algorithm: https://www.elastic.co/security-labs/detect-domain-generation-algorithm-activity-with-new-kibana-integration

DGA는 수백 또는 수천 개의 무작위로 생성된 도메인 이름을 동적으로 생성하며, 이 중 하나만이 C2 서버의 IP 주소로 확인됩니다. 이는 방어 시스템이 단순한 도메인 차단 목록(Blocklist)으로 악성 도메인을 차단하는 것을 불가능하게 만들어, 멀웨어의 지속성을 높이는 핵심 요소입니다.

DGA 탐지 패키지는 다음 핵심 요소를 포함합니다.

- 지도 머신러닝 모델 (Trained Model): DGA 패턴을 학습한 분류 모델로, DNS 쿼리 데이터가 악성(DGA)일 확률을 예측합니다.

- 수집 파이프라인 구성 (Ingest Pipeline): 수집 시점(Ingest Time)에 모델을 적용하여 들어오는 DNS 로그를 즉시 보강하는 프로세스를 정의합니다.

- 추론 프로세서 (Inference Processor): 수집 파이프라인 내에서 지도 학습 모델(ml_dga_inference_pipeline)을 호출하여 DNS 쿼리 필드에 대해 DGA 확률 점수를 부여합니다.

- 이상 징후 탐색 Job (Anomaly Detection Jobs): ML 모델의 예측 결과(확률 점수)를 기반으로 비지도 학습을 수행하여 이상 징후를 탐지합니다.

- 탐지 규칙 (Detection Rules): Kibana의 규칙 엔진에서 이상 징후 Job의 결과를 참조하여 최종 경보를 발생시킵니다.

Elastic Security의 DGA 탐지 통합 패키지는 지도 학습 모델을 Kibana 내에 통합하여, 방어 시스템이 피하기 어려웠던 DGA 기반 C2 통신을 효율적으로 식별할 수 있는 강력한 방어 메커니즘을 제공합니다. 이는 수집 시점의 데이터 보강과 ML 기반의 행동 분석을 결합함으로써, 최신 멀웨어 위협에 대한 선제적 보안 대응 능력을 대폭 강화합니다.

9. Elastic 머신 러닝 기술 자료

- Elastic 머신 러닝: https://www.elastic.co/guide/en/machine-learning/current/machine-learning-intro.html

- 머신 러닝 Job types: https://www.elastic.co/guide/en/machine-learning/current/ml-anomaly-detection-job-types.html

- Security anomaly detection configurations: https://www.elastic.co/docs/reference/data-analysis/machine-learning/ootb-ml-jobs-siem

- Machine learning analysis function reference: https://www.elastic.co/guide/en/machine-learning/current/ml-functions.html

- 머신 러닝 학습 설정 가이드: https://www.elastic.co/docs/explore-analyze/machine-learning/anomaly-detection/ml-ad-run-jobs#ml-ad-cardinality

- 머신 러닝 알고리즘: https://www.elastic.co/kr/blog/popular-ml-algorithms

실전사례: 웹 애플리케이션 로그 분석

로그 가공 작업은 분석되지 않거나 불필요한 정보를 치워서 좀더 효율적으로 이벤트를 분석하기 위한 작업 이다. 다음과 같은 가정을 해보자.

“일반적인 네트워크 트래픽엔 공격 패킷이나, 악성코드가 없다.”

하지만 이러한 트래픽은 짚더미처럼 수 없이 많다. 짚더미에 숨어 있는 바늘 같은 공격 트래픽을 찾는 일은 결코 쉬운 일이 아니다. 불필요한 정보들을 치워 보자.

웹 로그를 이용해 짚더미를 치우는 방법을 같이 살펴보자

로그 파서를 설치하고 실행 시키면 로그를 분석하기 위해서는 로그 타입을 “ IISW3CLOG” 형식으로 지정 한다.

<짚더미 1단계 – 메소드 점검>

먼저 분석할 웹 로그에서 응답 코드 현황에 대한 통계를 추출한다.

먼저 샘플 로그를 저장하고 해당 로그 위치를 경로로 지정해 다음과 같은 쿼리 문은 로그 파서 쿼리창에 입력하고 실행 버튼()을 클릭 하면 다음 그림처럼 응답코드 통계를 추출할 수 있다.

| SELECT sc-status AS Status, COUNT(*) AS Total FROM ‘C:\(로그파일 경로 지정)\ex*.log’ GROUP BY Status ORDER BY Total DESC |

<짚더미 치우기 2단계 – 정상으로 보이는 짚더미를 치운다>

일반적으로 웹 응답과정에서 자주 발생하는(흔히 정상 범주에 해당하는) 응답코드를 제외하고 나머지 코드를 살펴 보자. 정상 범주에 대한 기준은 다음과 같이 정의 하자.

| 응답코드 | 설명 |

| 200 | 클라이언트 요청이 성공했습니다. |

| 302 | 개체 이동 |

| 304 | 수정되지 않았습니다. |

| 404 | 찾을 수 없습니다. |

4개 응답코드를 제외하고 500(에러), 401(거부), 201(파일생성), 206(일부응답)와 같이 잘 발생하지 않는 응답코드 위주로 분석을 진행 하자. 동일하게 로그 파서 쿼리 창에 다음과 같이 입력하고 실행 한다.

| SELECT sc-status AS Status, cs-method, cs-uri-stem, c-ip FROM ‘C:\(로그파일 경로 지정)\ex*.log’ WHERE (Status = 500) or (Status = 401) or (Status = 201) or (Status = 206) |

총 25개의 결과물이 검색되었다. 25개 정도면 충분히 하나씩 전수 분석이 가능한 범위다. 응답코드를 정렬해서 하나씩 살펴보자.

먼저 201 응답 코드로 응답된 URL을 보면 /test.txt, /da.txt URL에 대해 3가지 메소드(PUT, COPY, MOVE)가 사용되었다.

| Status | cs-method | cs-uri-stem | c-ip |

| 201 | PUT | /test.txt | 192.168.20.20 |

| 201 | COPY | /test.txt | 192.168.20.20 |

| 201 | PUT | /da.txt | 192.168.20.37 |

| 201 | MOVE | /da.txt | 192.168.20.37 |

<짚더미 치우기 3단계 – 공격자 상세 분석>

이제 공격자로 의심되는 IP에 대해 상세하게 분석해 보자.

다음 그림 처럼 쿼리문을 입력하고 결과를 확인해 보자.

| SELECT TO_TIMESTAMP(date,time) as Datetime, sc-status, cs-method, cs-uri-stem, c-ip FROM ‘C:\(로그파일 경로 지정)\ex*.log’ WHERE c-ip like ‘192.168.20.37’ ORDER BY Datetime |

웹 로그를 분석해 보면 192.168.20.37 IP에서 PUT메소드를 이용해 da.txt파일을 업로드 하였고, 성공적으로(201 응답코드) 웹 서버에 파일이 업로드 된것을 알 수 있다. 이후 공격자는 MOVE메소드를 이용해서 업로드한 da.txt 파일을 fuck.asp 파일로 변경하였다.

해당 파일은 IIS 환경에서 동작하는 웹 쉘 파일로 공격자는 웹쉘을 이용해 웹 서버를 장악했다.

정상 범주의 데이터를 제거한 것만으로 공격자의 공격 경로를 찾아 낸 것이다.